什么是 AI 智能体及其核心能力

AI 智能体(AI Agent)是将大模型的“对话能力”升级为“执行能力”的智能化系统。它能感知环境、自主决策并调用工具以完成特定目标。如果把 LLM 比作博学但没有手的教授,AI 智能体就是给这位教授安装了手和眼睛,并配备了一套工作流,使其能独立完成订机票、部署代码或在企业软件中处理报销单等具体任务。

AI 智能体与传统聊天机器人的核心区别在于“闭环”。聊天机器人依赖单次指令(Prompt),而智能体依赖目标(Goal)。当你要求智能体“调研 2026 年第一季度竞品动态并生成报告”时,它会自主拆解为搜索信息、筛选关键点、撰写草稿和自我审核四个步骤。此时,用户从指令发送者变成了目标的定义者。

AI 智能体的底层运行逻辑

智能体的底层逻辑遵循“感知 -> 规划 -> 行动 -> 观察”的循环。目前主流方案基于 ReAct(Reason + Act)框架:接收任务后先生成内部推理链路(Thought),决定调用哪个工具(Action),执行并获取结果(Observation),最后根据结果更新认知。

这种机制通过“函数调用(Function Calling)”实现。例如,LLM 识别出需要操作表格,会输出一个符合 JSON 格式的 update_spreadsheet 参数给后端执行。这让 AI 突破了文本生成,获得了操纵数字世界的权力。

为了解决单体智能体在长链路任务中容易产生“幻觉”或陷入死循环的问题,架构已演进至“多智能体编排(MAS)”。通过角色分工——如一个定义产品、一个编写代码、一个负责验收——利用竞争与协作机制提升任务成功率。

实操指南:使用 CrewAI 构建多智能体团队

使用 CrewAI 构建多智能体团队的实操步骤如下:

需准备 Python 3.10+ 环境,执行

pip install crewai langchain_openai。通过 export OPENAI_API_KEY='your-key-here' 配置密钥。若使用 Llama 3 等本地模型,需将 base_url 指向本地推理服务器。

创建具有具体

role 和 backstory 的智能体(如 Senior Research Analyst 和 Content Strategist)。建议将 allow_delegation 设为 True,允许智能体之间协作。注意 backstory 必须具体,避免执行方向偏差。

定义 Task 对象并明确

expected_output(如 Markdown 格式)。必须将任务关联给对应的智能体,否则链路可能会失效。

使用

Crew 类组合智能体与任务,设置 process=Process.sequential 确保顺序执行,最后调用 crew.kickoff() 启动。

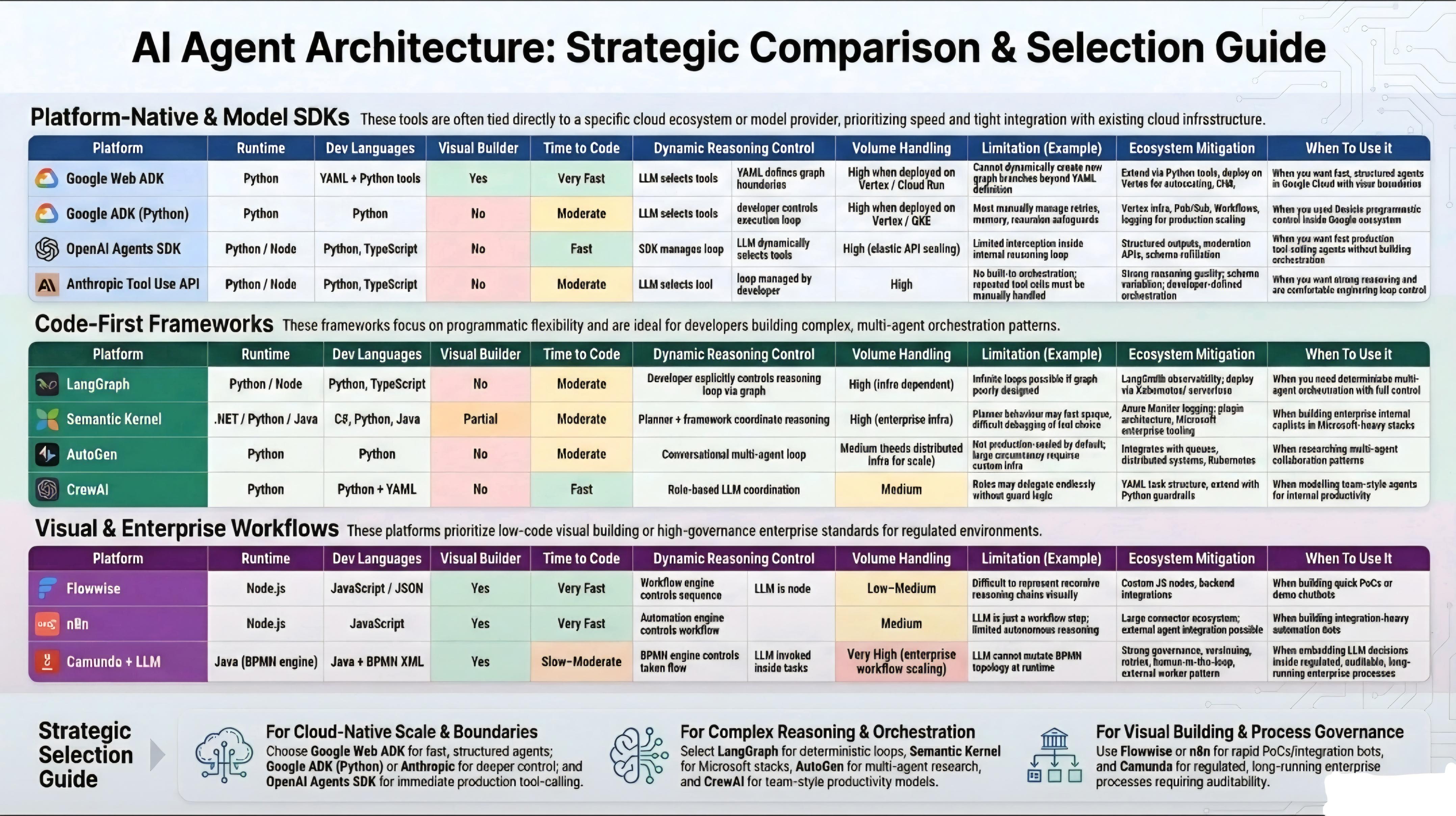

智能体构建工具对比与选择

选择智能体构建工具时可参考以下维度:

| 工具名称 | 核心优势 | 适用场景 | 局限性 |

|---|---|---|---|

| CrewAI | 多智能体协同,角色定义清晰 | 内容流水线、市场调研 | 实时响应开销大 |

| NoClick | 低代码可视化,上手快 | 个人助手、行政自动化 | 难以实现复杂逻辑 |

| LangGraph | 状态机控制,支持复杂循环 | 银行风控、医疗诊断 | 学习曲线陡峭 |

| AutoGPT (2026) | 自主探索能力极强 | 前沿技术探索、自动化爬虫 | 不可控且 Token 消耗快 |

局限性与落地建议

尽管能力提升,AI 智能体在以下场景仍存在局限:

- 极高容错率场景: 如数百万美元的资金交易,由于 LLM 的随机性,智能体应仅作为建议者而非最终决策者。

- 强实时物理反馈场景: 如手术机器人,LLM 的推理延迟无法满足亚秒级反应需求。

- 缺乏结构化数据的冷启动场景: 面对无 API 接口的封闭旧系统,目前的 RPA+视觉方案稳定性不足。

Q:如何避免 AI 智能体在执行过程中进入死循环?

可以通过设置最大迭代次数(Max Iterations)、在任务描述中