AI 绘画的底层逻辑与技术演进

AI 绘画是通过深度学习模型将文本或图像引导转化为视觉像素的生成技术。其底层逻辑是基于概率分布预测像素排列,而非人类习惯的“绘画”行为。到 2026 年 3 月,该技术已演变为集成实时渲染、精准编辑和多模态理解的工业级生产力系统。

技术普及正在降低创作门槛。过去,将灵感视觉化需要数年的美术训练,现在这种能力被数字化。但随之而来的挑战是:当高质量视觉作品成为低成本产物,艺术的独特性将取决于创作者的审美判断而非执行技巧。

目前主流工具依赖扩散模型(Diffusion Models)。

其原理是先向图像添加随机噪声使其混沌,再学习在特定文本标签(如“赛博朋克街道”)的引导下剔除噪声,还原出图像。2026 年的模型已在潜空间(Latent Space)实现高效运算,生成速度缩短至亚秒级,分辨率在保证细节的前提下突破 8K。

主流 AI 绘画工具的商业适用场景

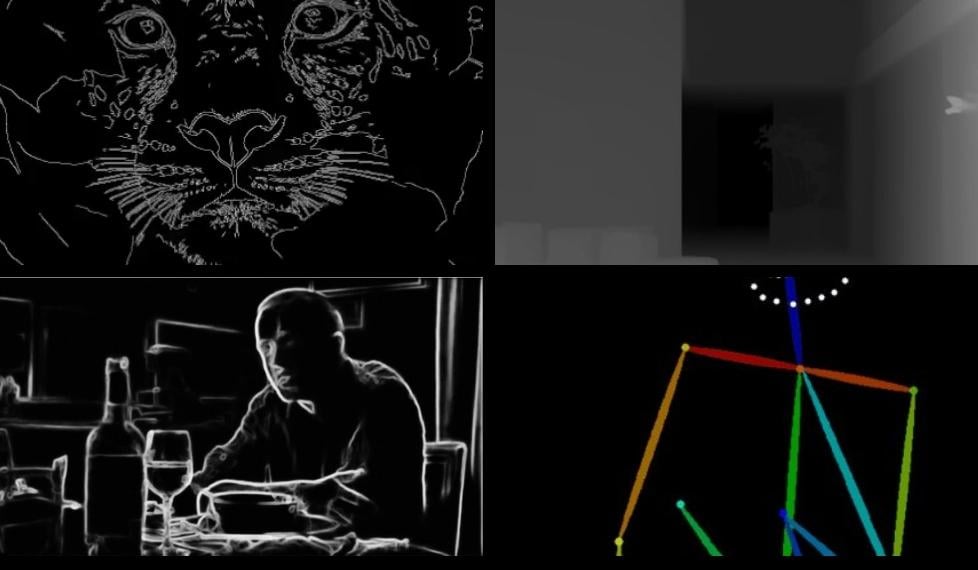

商业生产环境中的工具链主要分为三类:Midjourney v7 侧重“审美优先”,适合快速产出高艺术感作品,但微调空间小;DALL-E 4 强在“语义理解”,能精准执行复杂的空间逻辑指令;Stable Diffusion (SD) 则像“手术刀”,通过 ControlNet 和 LoRA 插件,允许用户精确控制骨架、光影和特定画风。

商业级图像生成标准化工作流

要构建商业级图像生成工作流,不能依赖随机 Prompt,而应采用“引导 -> 生成 -> 精修”的闭环。以下是以 Stable Diffusion 2026 版为例的操作路径:

第一步:部署 ControlNet 构建控制层

第二步:利用 LoRA 固化风格或角色

<lora:name:weight> 调用模型,建议权重在 0.5-0.7,避免过高导致画面出现锐化过度或色彩崩坏的“烧焦感”。若需自定义角色,需准备 20-50 张多角度高质量图,使用 Kohya_ss 脚本,学习率设为 1e-4,训练 2000 step。

第三步:局部重绘与超分增强

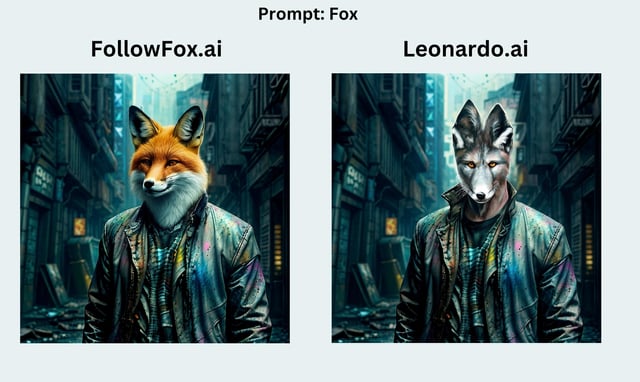

多维度工具对比分析

不同工具的维度拆解如下

| 维度 | Midjourney v7 | Stable Diffusion | DALL-E 4 |

|---|---|---|---|

| 价格模式 | 订阅制 (10-60 USD/月) | 开源免费 (依赖硬件) | 按量计费 |

| 核心优势 | 光影审美顶级 | 可控性最强 (插件丰富) | 语义指令最精准 |

| 版权风险 | 法律保障相对较多 | 训练集争议较大 | 法律保障相对较多 |

| 适用场景 | 海报创意/视觉探索 | 产品渲染/商业交付 | 概念验证/快速打样 |

从执行力向审美力的认知升级

AI 取代的是“执行力”而非“审美力”。正如 19 世纪摄影术推动绘画向印象派进化,AI 绘画正让创作者从繁重的体力绘制中解脱。能够定义美感的人,会因为 AI 的加持而增强竞争力。

但 AI 并非万能,在三个场景下效率依然低下:一是极致精准度需求,如建筑施工图或精密零件;二是复杂叙事逻辑,如处理精细的空间遮挡关系;三是情感深度,无法完全理解特定文化语境下的冲击力。

建议将重心转向“导演思维”。与其死磕 Prompt,不如研究艺术史、色彩理论和构图学。尝试将商业项目拆解为:构图草图 → AI 初稿 → 手动修正 → AI 增强。这种流程能让生产力实现数量级的提升。